下面是通过requests库来对ajax页面进行爬取的案例,与正常页面不同,这里我们获取url的方式也会不同,这里我们通过爬取一个简单的ajax小说页面来为大家讲解。(注:结尾附赠全部代码与详细注释)

爬取数据必须有相应的库,这里我们使用爬虫脚本中常用的几个Python库:os.path、fake_useragent 和 requests。

1.os.path:

2.fake_useragent:

3.requests:

import os.path import fake_useragent import requests

正确地设置代码的基础部分

这里我们生成一个随机的User-Agent、检查并创建目录以便储存爬取的图片、以及打开(或创建)一个文本文件来保存数据。

import os.path

import fake_useragent

import requests

# 判断是否是直接运行该脚本

if __name__ == '__main__':

head = {"User-Agent": fake_useragent.UserAgent().random}

if not os.path.exists("./biqugePic"):

os.mkdir("./biqugePic")

f = open("./biquge.txt", 'w', encoding='utf8') 循环遍历URL(这里为大家提供具体url的获取方法,并循环了1至9页的数据为大家做案例),并发送了带有随机User-Agent的GET请求。这是爬虫中常见的做法,用于从网站的不同页面获取数据。

for i in range(null, 10):

url = f"https://www.bqgui.cc/json?sortid=1&page={i}"

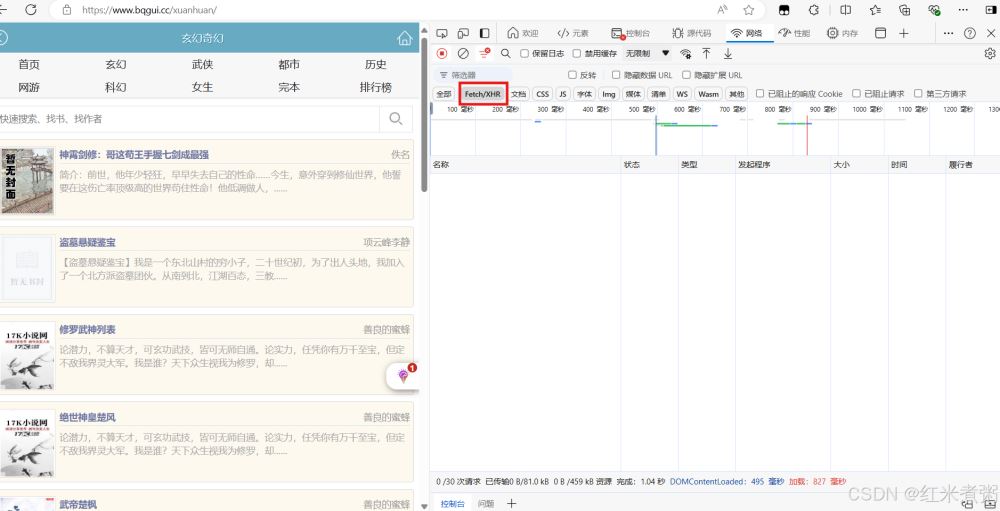

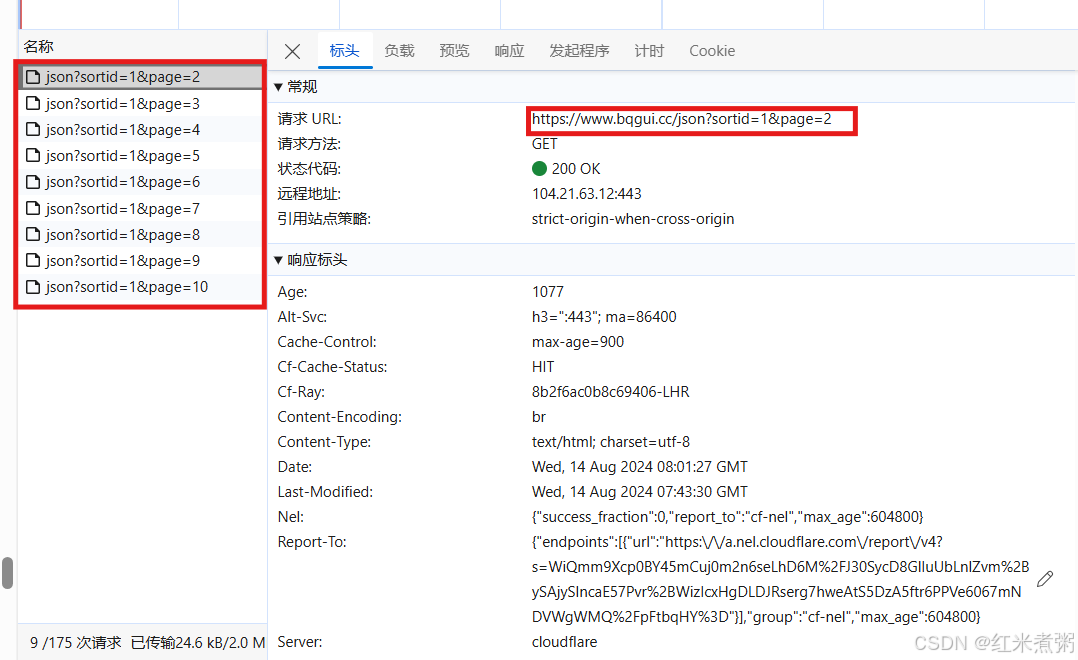

resp = requests.get(url, headers=head) 首先进入网页,点击F12打开自定义与控制工具,点击fecth/XHR,此时显示部分为空白。

这个时候我们滚动鼠标滚轮,就会出现相应的url,这里的https://www.bqgui.cc/json?sortid=1&page=2,其中尾部2表示滚轮页面第二页,想要获取1至9我们只需要进行一个简单的循环遍历即可。

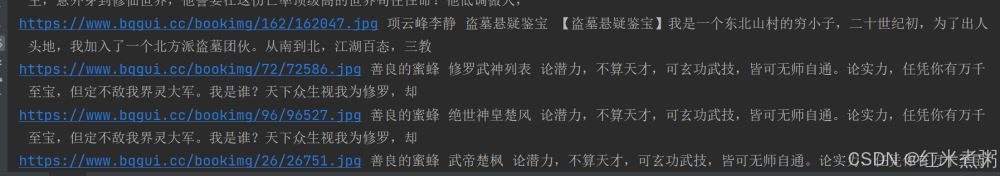

遍历从URL获取的JSON响应,该响应包含多个项目。对于每个项目,您都提取了图片URL、文章名、作者和简介,并计划将这些信息打印到控制台以及下载图片和保存文本信息到文件。

for item in resp.json():

# 从每个JSON对象中提取所需的信息

img_url = item['url_img']

articlename = item['articlename']

author = item['author']

intro = item["intro"]

# 打印提取的信息到控制台

print(img_url, author, articlename, intro)

# 发送另一个GET请求到图片URL,以获取图片内容

img_rest = requests.get(img_url, headers=head)

设置代码来保存图片到以文章名命名的文件中,并将作者、文章名和简介信息写入到"./biquge.txt"文件中。

with open(f"./biqugePic/{articlename}.jpg", "wb") as fp:

# 将图片内容写入文件

fp.write(img_rest.content)

# 将作者、文章名和简介信息写入到"./biquge.txt"文件中

f.write(author + '#' + articlename + '#' + intro + "\n")全部代码即详细注释

import os.path

import fake_useragent

import requests

# 判断是否是直接运行该脚本

if __name__ == '__main__':

# 创建一个包含随机User-Agent的HTTP请求头

head = {"User-Agent": fake_useragent.UserAgent().random}

# 检查是否存在名为"./biqugePic"的文件夹,如果不存在则创建它

if not os.path.exists("./biqugePic"):

os.mkdir("./biqugePic")

# 以写入模式打开(或创建)一个名为"./biquge.txt"的文件,用于保存数据

f = open("./biquge.txt", 'w', encoding='utf8')

# 循环从第1页到第9页(注意,range函数是左闭右开的,所以不包括10)

for i in range(null, 10):

# 构造请求URL,这里假设每个页面的数据都可以通过此URL以JSON格式获取

url = f"https://www.bqgui.cc/json?sortid=1&page={i}"

# 发送GET请求到URL,并带上之前创建的请求头

resp = requests.get(url, headers=head)

# 假设服务器返回的是JSON格式的数据,我们遍历这些数据

# 注意:这里有个潜在的问题,因为内部循环的变量也使用了'i',这会覆盖外层循环的'i'

# 为了避免混淆,应该使用另一个变量名,比如'item'

for item in resp.json():

# 从每个JSON对象中提取所需的信息

img_url = item['url_img']

articlename = item['articlename']

author = item['author']

intro = item["intro"]

# 打印提取的信息到控制台

print(img_url, author, articlename, intro)

# 发送另一个GET请求到图片URL,以获取图片内容

img_rest = requests.get(img_url, headers=head)

# 打开(或创建)一个文件,用于保存图片,文件名基于文章名

with open(f"./biqugePic/{articlename}.jpg", "wb") as fp:

# 将图片内容写入文件

fp.write(img_rest.content)

# 将作者、文章名和简介信息写入到"./biquge.txt"文件中

f.write(author + '#' + articlename + '#' + intro + "\n") 注意:

到此这篇关于python爬虫爬取某图书网页实例的文章就介绍到这了,更多相关python爬虫爬取某图书网页内容请搜索插件窝以前的文章或继续浏览下面的相关文章希望大家以后多多支持插件窝!